Der Bedarf und die Nachfrage nach nutzergenerierten Daten in der heutigen dynamischen Geschäftswelt nimmt kontinuierlich zu und auch die Moderation von Inhalten erhält ausreichend Aufmerksamkeit.

Ganz gleich, ob es sich um Social-Media-Beiträge, Produktrezensionen oder Blog-Kommentare handelt, benutzergenerierte Daten bieten im Allgemeinen eine ansprechendere und authentischere Art der Markenwerbung. Leider entsprechen diese nutzergenerierten Daten nicht immer den höchsten Standards und stellen eine effektive Inhaltsmoderation vor die Herausforderung.

Durch die Moderation von KI-Inhalten wird sichergestellt, dass Ihre Inhalte mit den beabsichtigten Zielen des Unternehmens übereinstimmen und eine sichere Online-Umgebung für Benutzer geschaffen wird. Schauen wir uns also die vielfältige Landschaft der Inhaltsmoderation an und erkunden wir ihre Arten und Rolle bei der Optimierung von Inhalten für Marken.

KI-Inhaltsmoderation: Ein aufschlussreicher Überblick

Die Moderation von KI-Inhalten ist ein effektiver digitaler Prozess, der KI-Technologien nutzt, um benutzergenerierte Inhalte auf verschiedenen digitalen Plattformen zu überwachen, zu filtern und zu verwalten.

Durch die Inhaltsmoderation soll sichergestellt werden, dass die von den Nutzern eingestellten Inhalte den Community-Standards, Plattformrichtlinien und gesetzlichen Vorschriften entsprechen.

Bei der Inhaltsmoderation geht es um die Durchsicht und Analyse von Texten, Bildern und Videos, um Problembereiche zu identifizieren und anzugehen.

Der Prozess der Inhaltsmoderation erfüllt mehrere Zwecke, wie z

- Filtern unangemessener oder schädlicher Inhalte

- Minimierung rechtlicher Risiken

- Aufrechterhaltung der Markensicherheit

- Verbesserung der Geschwindigkeit, Konsistenz und Skalierbarkeit des Unternehmens

- Verbesserung der Benutzererfahrung

Lassen Sie uns etwas tiefer gehen und die Inhaltsmoderation mit ihren verschiedenen Arten und ihrer Rolle darin anschaulicher erkunden:

[Lesen Sie auch: Grundlegendes zur automatisierten Inhaltsmoderation]

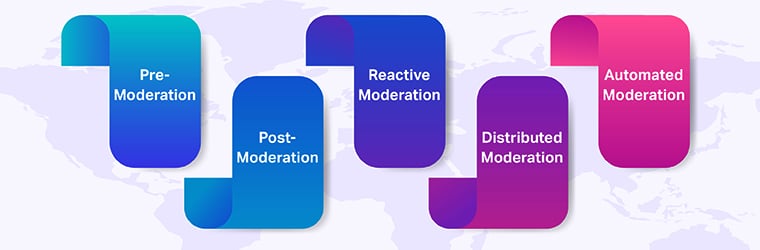

Ein Einblick in die Reise der Content-Moderation: 5 Schlüsselphasen

Hier sind die fünf wichtigsten Phasen, die die Daten durchlaufen, bevor sie die richtige Form annehmen:

Vormoderation

Dabei werden Inhalte überprüft und genehmigt, bevor sie auf einer Plattform veröffentlicht werden. Diese Methode bietet eine strenge Kontrolle über den Inhalt und stellt sicher, dass nur Inhalte live geschaltet werden, die bestimmten Geschäftsrichtlinien entsprechen. Obwohl diese Methode bei der Generierung hoher Inhaltsqualität äußerst effektiv ist, kann sie die Verbreitung von Inhalten verlangsamen, da sie eine kontinuierliche menschliche Überprüfung und Genehmigung erfordert.

Beispiel aus der realen Welt:

Amazon ist eine beliebte Marke, die Content-Moderation nutzt, um die Angemessenheit ihrer Inhalte sicherzustellen. Da Amazon regelmäßig Tausende von Produktbildern und -videos bearbeitet, stellt das Amazon Rekognition-Tool sicher, dass der Inhalt validiert wird. Mithilfe der Vormoderationsmethode werden explizite Inhalte, die dem Ruf des Unternehmens schaden könnten, zu über 80 % erkannt.

Nachmoderation

Im Gegensatz zur Pre-Moderation können Benutzer bei der Post-Moderation Inhalte in Echtzeit einreichen, ohne dass eine vorherige Überprüfung erforderlich ist. Das bedeutet, dass der Inhalt sofort auf dem Live-Server bereitgestellt wird, aber einer weiteren Prüfung unterzogen wird. Dieser Ansatz ermöglicht eine schnellere Verbreitung von Inhalten. Allerdings birgt die Nachmoderation auch das Risiko der Veröffentlichung unangemessener oder schädlicher Inhalte.

Beispiel aus der realen Welt:

YouTube ist ein klassisches Beispiel dafür. Es ermöglicht seinen Benutzern, den Inhalt zuerst zu veröffentlichen und zu veröffentlichen. Später überprüft es die Videos und meldet sie auf Unangemessenheit oder Urheberrechtsprobleme.

Reaktive Moderation

Es handelt sich um eine großartige Technik, die von einigen Online-Communities eingesetzt wird, um unangemessene Inhalte zu kennzeichnen. Reaktive Moderation wird im Allgemeinen mit der Vor- oder Nachmoderationsmethode verwendet und basiert auf Benutzerberichten oder automatisierten Kennzeichnungssystemen, um Inhaltsverstöße zu identifizieren und zu überprüfen. Die Online-Communities nutzen mehrere Moderatoren, die die identifizierten unangemessenen Daten bewerten und die erforderlichen Maßnahmen ergreifen, um sie zu entfernen.

Beispiel aus der realen Welt:

Facebook nutzt die Methode der reaktiven Moderation, um die auf seiner Plattform vorhandenen Inhalte zu überprüfen. Es ermöglicht seinen Benutzern, unangemessene Inhalte zu kennzeichnen, und führt auf der Grundlage der kollektiven Bewertungen die erforderlichen Maßnahmen weiter aus. Kürzlich hat Facebook eine KI für die Inhaltsmoderation entwickelt, die eine Erfolgsquote von über 90 % bei der Kennzeichnung von Inhalten liefert.

Verteilte Moderation

Diese Methode basiert auf der Beteiligung der Benutzer, um den Inhalt zu bewerten und festzustellen, ob er für die Marke geeignet ist oder nicht. Die Nutzer stimmen über die vorgeschlagene Auswahl ab und die durchschnittliche Bewertung entscheidet darüber, welche Inhalte gepostet werden.

Der einzige Nachteil der verteilten Moderation besteht darin, dass die Integration dieses Mechanismus in Marken eine große Herausforderung darstellt. Benutzern die Moderation von Inhalten anzuvertrauen, birgt eine Reihe von Branding- und rechtlichen Risiken.

Beispiel aus der realen Welt:

Wikipedia nutzt den Verteilungsmoderationsmechanismus, um Genauigkeit und Inhaltsqualität aufrechtzuerhalten. Durch die Einbindung verschiedener Redakteure und Administratoren stellt das Team Wikipedia sicher, dass nur die richtigen Daten auf die Website hochgeladen werden.

Automatisierte Moderation

Es handelt sich um eine einfache, aber effektive Technik, die erweiterte Filter verwendet, um Wörter aus einer Liste zu erfassen und dann auf voreingestellte Regeln zu reagieren, um Inhalte herauszufiltern. Die dabei eingesetzten Algorithmen erkennen Muster, die in der Regel potenziell schädliche Inhalte generieren. Diese Methode veröffentlicht effizient fein abgestimmte Inhalte, die ein höheres Engagement und mehr Website-Traffic generieren können.

Beispiel aus der realen Welt

Automatisierte Moderation wird von verschiedenen Unternehmen eingesetzt Spieleplattformen, einschließlich Playstation und Xbox. Diese Plattformen verfügen über automatisierte Methoden, die Spieler erkennen und bestrafen, die gegen Spielregeln verstoßen oder Cheat-Codes verwenden.

KI-gestützte Anwendungsfälle in der Inhaltsmoderation

Die Inhaltsmoderation ermöglicht die Entfernung der folgenden Datentypen:

- Explizite Inhalte ab 18 Jahren: Dabei handelt es sich um sexuell eindeutige Inhalte, die Nacktheit, Vulgarität oder sexuelle Handlungen beinhalten.

- Aggressiver Inhalt: Dabei handelt es sich um Inhalte, die Bedrohungen oder Belästigungen darstellen oder schädliche Sprache enthalten. Dazu kann auch gehören, dass Einzelpersonen oder Gruppen gezielt angegriffen werden und häufig gegen Community-Richtlinien verstoßen wird.

- Inhalte mit unangemessener Sprache: Dabei handelt es sich um Inhalte, die beleidigende, vulgäre oder unangemessene Sprache enthalten, etwa Schimpfwörter und Beleidigungen, die die Gefühle einer Person verletzen könnten.

- Irreführender oder falscher Inhalt: Dabei handelt es sich um falsche Informationen, die absichtlich verbreitet werden, um das Publikum falsch zu informieren oder zu manipulieren.

Die KI-Inhaltsmoderation stellt sicher, dass alle diese Inhaltstypen abgerufen und entfernt werden, um genauere und zuverlässigere Inhalte bereitzustellen.

Bewältigung der Datenvielfalt durch Inhaltsmoderation

Inhalte sind in digitalen Medien in vielfältiger Art und Form vorhanden. Daher erfordert jede Art einen speziellen Moderationsansatz, um optimale Ergebnisse zu erzielen:

[Lesen Sie auch: 5 Arten der Inhaltsmoderation und wie man sie mit KI skaliert?]

Textdaten

Für die Textdaten erfolgt die Inhaltsmoderation mithilfe der NLP-Algorithmen. Diese Algorithmen verwenden Sentiment-Analyse um den Ton eines bestimmten Inhalts zu identifizieren. Sie analysieren den geschriebenen Inhalt und erkennen etwaigen Spam oder schlechten Inhalt.

Darüber hinaus nutzt es auch Entity Recognition, das Unternehmensdemografien nutzt, um die Fälschung von Inhalten vorherzusagen. Basierend auf den identifizierten Mustern wird der Inhalt als sicher oder unsicher gekennzeichnet und kann weiter gepostet werden.

Sprachdaten

Die Moderation von Sprachinhalten hat in letzter Zeit mit dem Aufkommen von Sprachassistenten und sprachaktivierten Geräten enorm an Bedeutung gewonnen. Um den Sprachinhalt erfolgreich zu moderieren, wird ein Mechanismus namens Sprachanalyse genutzt.

Die Sprachanalyse basiert auf KI und bietet:

- Übersetzung von Stimme in Text.

- Stimmungsanalyse des Inhalts.

- Interpretation des Stimmtons.

Bilddaten

Bei der Moderation von Bildinhalten kommen Techniken wie Textklassifizierung, Bildverarbeitung und visionsbasierte Suche zum Einsatz. Diese leistungsstarken Techniken analysieren die Bilder gründlich und erkennen schädliche Inhalte im Bild. Das Bild wird zur Veröffentlichung weitergeleitet, wenn es keine schädlichen Inhalte enthält, oder alternativ gekennzeichnet.

Videodaten

Die Videomoderation erfordert die Analyse von Audio, Videobildern und Text in Videos. Dazu nutzt es die gleichen Mechanismen wie oben für Text, Bild und Sprache. Durch die Videomoderation wird sichergestellt, dass unangemessene Inhalte schnell erkannt und entfernt werden, um eine sichere Online-Umgebung zu schaffen.

Zusammenfassung

Die KI-gesteuerte Inhaltsmoderation ist ein wirksames Werkzeug zur Aufrechterhaltung der Inhaltsqualität und -sicherheit über verschiedene Datentypen hinweg. Da benutzergenerierte Inhalte weiter zunehmen, müssen sich Plattformen an neue und effektive Moderationsstrategien anpassen, die ihre geschäftliche Glaubwürdigkeit und ihr Wachstum steigern können. Sie können Nehmen Sie Kontakt mit unserem Shaip-Team auf wenn Sie an Content Moderation für Ihr Unternehmen interessiert sind.