Fallstudie: Inhaltsmoderation

Über 30 Dokumente wurden für die Inhaltsmoderation im Web verschrottet und kommentiert

die danach streben, den Online-Raum zu sichern, in dem wir uns vernetzen und kommunizieren.

Da die Nutzung sozialer Medien weiter zunimmt, ist die

Das Problem des Cybermobbings ist aufgetaucht

erhebliche Hürde für Plattformen, die danach streben

Sorgen Sie für einen sicheren Online-Bereich. Eine Erschütterung

38 % der Menschen sind davon betroffen

schädliches Verhalten im Alltag,

Betonung des dringenden Bedarfs an Erfindergeist

Ansätze der Inhaltsmoderation.

Heutzutage verlassen sich Organisationen auf den Einsatz von

Künstliche Intelligenz zur Bewältigung des Dauerhaften

Problem des Cybermobbings proaktiv.

Onlinesicherheit:

Facebooks Q4 Community Standards Enforcement Report enthüllt – Maßnahmen gegen 6.3 Millionen Mobbing- und Belästigungsinhalte mit einer proaktiven Erkennungsrate von 49.9 %

Ausbildung:

A 2021 Studie ergab, dass 36.5%% der Studenten in den Vereinigten Staaten im Alter zwischen 12 & 17 Jahre während ihrer Schulzeit Cybermobbing erlebt haben.

Laut einem Bericht aus dem Jahr 2020 wurde der globale Markt für Content-Moderationslösungen im Jahr 4.07 auf 2019 Milliarden US-Dollar geschätzt und soll bis 11.94 2027 Milliarden US-Dollar erreichen, mit einer durchschnittlichen jährlichen Wachstumsrate von 14.7 %.

Real-World-Lösung

Daten, die globale Gespräche moderieren

Der Kunde entwickelte eine robuste Automatisierung

Inhaltsmoderation Maschinelles Lernen

Modell für sein Cloud-Angebot, für das sie

suchten nach einem domänenspezifischen Anbieter, der

könnte ihnen mit genauen Trainingsdaten helfen.

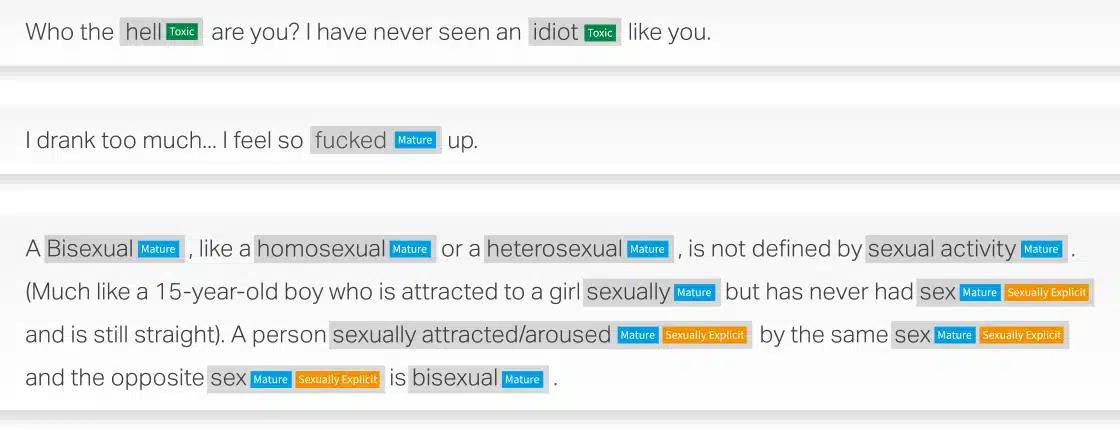

Unter Nutzung unseres umfassenden Wissens in der Verarbeitung natürlicher Sprache (NLP) unterstützten wir den Kunden beim Sammeln, Kategorisieren und Kommentieren von mehr als 30,000 Dokumenten in Englisch und Spanisch, um ein automatisiertes Modell für maschinelles Lernen zur Moderation von Inhalten zu erstellen, das in toxische, nicht jugendfreie oder sexuell explizite Inhalte aufgeteilt wurde Kategorien.

Aufgabenstellung:

- Web-Scraping von 30,000 Dokumenten in Spanisch und Englisch aus priorisierten Domänen

- Kategorisierung der gesammelten Inhalte in kurze, mittlere und lange Segmente

- Kennzeichnung der zusammengestellten Daten als giftiger, nicht jugendfreier oder sexuell expliziter Inhalt

- Gewährleistung hochwertiger Anmerkungen mit einer Genauigkeit von mindestens 90 %.

Lösung

- Web hat jeweils 30,000 Dokumente für Spanisch und Englisch von BFSI, Gesundheitswesen, Fertigung und Einzelhandel verschrottet. Der Inhalt wurde weiter in kurze, mittlere und lange Dokumente unterteilt

- Der Inhalt wurde erfolgreich als giftiger, nicht jugendfreier oder sexuell eindeutiger Inhalt eingestuft

- Um eine Qualität von 90 % zu erreichen, hat Shaip einen zweistufigen Qualitätskontrollprozess implementiert:

» Stufe 1: Qualitätssicherungsprüfung: 100 % der Dateien werden validiert.

» Stufe 2: Kritische Qualitätsanalyseprüfung: Das CQA-Team von Shaips bewertet 15 % bis 20 % der retrospektiven Proben.

Ergebnis

Die Trainingsdaten halfen beim Aufbau eines automatisierten ML-Modells für die Inhaltsmoderation, das mehrere Ergebnisse liefern kann, die für die Aufrechterhaltung einer sichereren Online-Umgebung von Vorteil sind. Zu den wichtigsten Ergebnissen gehören:

- Effizienz bei der Verarbeitung großer Datenmengen

- Konsequente Gewährleistung einer einheitlichen Durchsetzung der Moderationsrichtlinien

- Skalierbarkeit zur Anpassung an wachsende Benutzerbasis und Inhaltsmengen

- Echtzeit-Moderation kann &

Entfernen Sie potenziell schädliche Inhalte, sobald sie generiert werden - Kosteneffizienz durch Reduzierung der Abhängigkeit von menschlichen Moderatoren

Beispiele für Content-Moderation

Sagen Sie uns, wie wir Sie bei Ihrer nächsten KI-Initiative unterstützen können.